硬实力!中科大、浙大接连出手量子芯片

文/黄珊

来源:DeepTech深科技(ID:deeptechchina)

中国的量子计算机又迎来重要进展。在一周之内,由中国科学技术大学和浙江大学主导的两支研究团队分别在《物理评论快报》和 Science 上发表了其在量子计算上的最新研究。两个研究的重点并不相同,但都采用了高量子比特芯片作为基础物理研究课题的实验平台,显示了中国作为量子计算第一梯队的实力。

也就是说,在其他国家的研究团队还在纠结如何增加芯片中的量子比特数以及纠错算法时,我国科学家已经可以用高量子比特芯片来做实际的研究了。

中科大:在 24 位量子比特量子芯片上施展“魔法”

来自中科大潘建伟研究团队的“Propagation and Localization of Collective Excitations on a 24-Qubit Superconducting Processor”,文章刊登于 2019 年 7 月 31 日的《物理评论快报》(Physics Review Letter)上。三位第一作者中有两位来自中科大,另一位来自中科院北京国家凝聚态研究所。

中科大团队在文章中展示了他们在 24 位量子比特量子芯片上施展的“魔法”。

研究团队选取了基础物理中十分经典的研究课题——“玻色-哈勃德模型(Bose-Hubbard Model)”。简单而言,这是一个基本粒子相互作用力的物理模型,研究对象是玻色子(自旋量子数为整数倍的微小粒子),例如实验中使用的光子。

怎么来研究相互作用力?一般是在实验中将系统中某个玻色子的状态改变,再观察它以及其他玻色子状态变化,并以此推出它们之间的相互作用力。

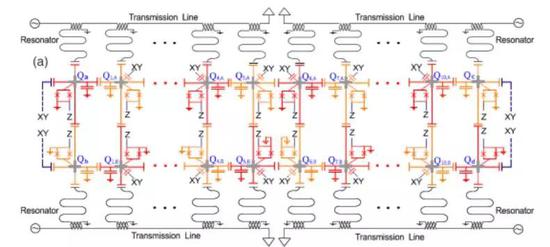

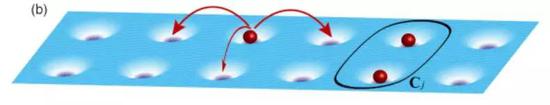

具体来说,研究团队采用一块 24 量子比特(Qubit)的量子芯片进行试验,如图所示,量子比特 Q1A~Q10A 以及 Q1B~Q10B 中的光子是实验中编码和观测的对象,它们之间由电容耦合在一起,那么这 20 个量子比特就形成了一个 2 x 10 的“梯子”。如果我们将其中一个光子置为激发态,即图中的红色球,它可能会引起旁边三个光子的状态变化,就像球从一个坑移动到另一个坑一样。

可以理解为,这就是一个看光子的激发态怎么爬梯的实验。

首先,研究人员将边缘量子比特的光子置为激发态,它会像球一样,结果显示激发态会从一边传递到另一边,这和玻色-哈勃德模型的理论相符合,而实验的结果和仿真计算结果吻合。接着,他们做了第二个实验,将两端对角的两个边缘量子比特光子置为激发态,实验结果显示,两个光子的激发态相互独立地从一端移动到了另一端。最后,他们将一端的两个光子同时置为激发态,并探求这种情况下整个玻色-哈勃德梯子的状态,他们发现此时激发态并没有“传播”下去,而是在一端形成局部化的状态。

这样的实验结果看似十分简单,但是却有着重要的研究意义。

首先,实验结果验证了玻色-哈勃德模型的理论,并在一定意义上显示了玻色子之间的强相互作用力,对于基础粒子的研究具有重要意义;其次,我们如果将光子看成是能够存储信息的单元,而事实上它们也是存在于量子芯片的量子比特上的,那么这样的实验也可以看成是量子比特间进行通信的尝试和探索,对于量子计算机以及量子通信有指导意义;最后实验本身验证了 24-Qubit 量子芯片的正确性,我们有理由相信今后会有更多、更复杂的实验能够在这样的架构上实现。

刷新量子芯片世界纪录,“虐猫狂人”出浙大

浙江大学为主的研究团队虽然也是开发并使用高量子比特的量子芯片,但是他们有新的亮点。研究团队的成员来自浙江大学、中科院物理所、中科院自动化所、北京计算科学研究中心等研究机构,他们通力合作开发出具有 20 个超导量子比特的量子芯片,虽然量子比特数没有达到 24,但是该芯片成功操控其实现全局纠缠,刷新了固态量子器件中生成纠缠态的量子比特数目的世界纪录。实验成果以文章的形式发表于 Science 杂志上。

在量子计算领域,高量子比特的量子芯片或者计算机有着超乎寻常的计算能力,而且位数越多,能力越大。全局纠缠,通俗的理解就是让所有量子比特协同起来参与工作。

本文的共同第一作者许凯总结道:“与世界上其他的超导量子芯片相比,我们研发的芯片拥有一个显著特点,那就是所有比特之间都能够进行相互连接,这能够提升量子芯片的运行效率,也是我们能够率先实现 20 比特纠缠的重要原因之一。”

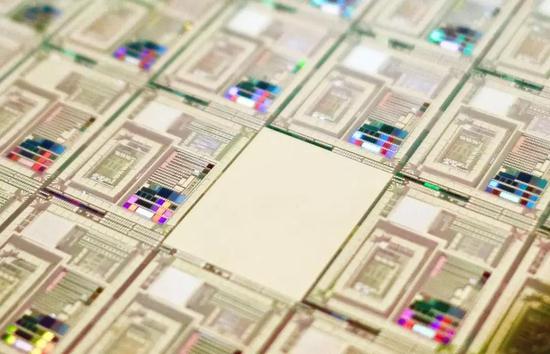

这种芯片架构,20 个超导量子比特如图一样呈现两排平行的排列。与电脑的架构类似,在芯片中间采用了一条总线(Bus)作为所有量子比特相互连接的途径。而每一个量子比特又有自己的控制端口(如图中所示的红线和蓝线)。也就是说,每一个量子比特都能独立编程、读写以及检测,而总线的设计又将这些量子比特联系在了一起,实现全局纠缠。

如此强大的芯片自然要用来做实验。研究团队基于芯片的全局纠缠实现了 18 比特的全局纠缠的GHZ 态,以及 20 比特的薛定谔猫态。文章的共同第一作者宋超说:“我们确实看到了在经典世界中看不到的现象,用更形象(的表述)就是——一只由 20 个人造原子构成的‘猫’,薛定谔猫态。”

所谓薛定谔的猫态,就是不确定状态的叠加。正如“薛定谔的猫”这一著名思维实现阐述,我们未打开盒子之前的猫应该是“不死不活”的,是“死”和“活”状态的叠加,但是我们无法在宏观经典世界看见这所谓的“不死不活”的猫。然而随着量子力学的发展,科学家已先后通过各种方案获得了宏观量子叠加态,即薛定谔猫态。此前,科学家最多使 4 个离子或 5 个光子达到“薛定谔猫”态。但如何使更多粒子构成的系统达到这种状态,已成为实验物理学的一大挑战。

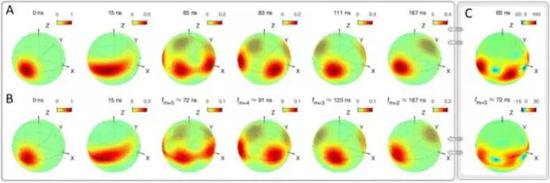

实验开始前,研究团队将 20 个量子比特的初始状态设置为统一的相干态,同一时间“释放”。

结果令人激动,在短短的 187 纳秒之内,20 个量子比特经历多次变换,最终形成同时存在两种相反状态的量子纠缠态——他们真的看见了“不死不活”的猫了!能够控制这些量子比特生成全局纠缠态,也彰显了研究团队精确控制和检测量子比特的能力,而这精彩的187纳秒,也见证了人类在量子计算研究上翻开了新的一页。

方兴未艾的量子计算

最近几年,量子计算、量子芯片、量子纠缠等词汇以极高的频率出现在公众视野中,为什么大家都热衷于此?

量子计算可以说是计算能力最有可能超越经典计算机的技术了,而现存的量子计算机也证明了这一点,国际上各大计算机公司、大学及研究机构都在你追我赶地进行量子计算的研究,诸如谷歌、IBM、微软、英特尔、华为、阿里巴巴等全球高科技公司都为此投入大量研究力量。

量子计算机的概念始于上世纪 80 年代:1982 年,著名物理学家理查德·费曼提出设想:既然自然的本质是量子的,我们能否造出一台遵循量子规律的计算机,去更好地认识量子世界?理论上来说,量子计算机的计算能力会比经典计算机要高得多。经典计算机就是我们现在日常使用的计算机,它的运算和存储单元是“1 字节(bit)”,以二进制为运算法则。1 字节中的状态为“0”或者“1”。

然而,量子计算机的运算和存储单元“1 量子比特”,这个量子比特存储数据的能力与字节就不能同日而语了。

量子比特的运算法则遵循量子力学的叠加原理,例如著名的薛定谔的猫,在我们打开盒子之前,猫的状态是无法确定的,可以说是不死不活,是“死和活”的叠加状态。类似地,1 个量子比特的状态就可以是“0”和“1”的叠加状态,如此一来,一个量子比特拥有的信息量就比经典计算机中的 1 字节中的要多得多了。

举个栗子,考虑一个 N 个物理比特的存储器,若它是经典存储器,则它只能存储2^N 个可能数据当中的任意一个;若它是量子存储器,则它可以同时存储 2^N 个数,而且随着 N 的增加,其存储信息的能力将呈指数上升。这也是当今量子计算巨头都在争相追赶高位数量子计算机的原因。

(来源:FLICKR)

(来源:FLICKR) 理论上性能如此强大的量子计算机为何至今还没有投入大规模使用?

原因有很多,首先,量子计算机基于量子比特,而量子比特的工作环境要求十分严苛,以本文即将介绍的两个实验为例,两个团队的量子芯片分别有24个量子比特和 20 个量子比特,它们由超导体的电路构成。而超导体的形成条件就十分严苛了,一般要求超低温,那么这样的条件是不可能走入寻常百姓家的。其次,从量子比特到量子芯片再到量子计算机,这一条路看似简单,其实还有很多设计和架构上的问题。不同于经典计算机,量子芯片和量子计算机的架构无法直接套用经典计算机的技术,控制算法要求十分精确。

最后,量子比特的纠错问题也是十分具体的,来自量子比特内的热量、来自基本的量子力学过程的随机波动都可能会干扰量子比特的状态,从而造成计算错误。为了处理这些错误,我们需要增加额外的量子比特或者预先指定一部分量子比特来进行纠错,这样一来,就有很大一部分计算能力要被用于纠正错误,而不是进行计算。

不过,尽管有这么多问题,量子计算机仍将是人类为之向往的科技,让我们期待科学家带来更多的技术突破。

2019-08-14 23:07:46

2019-08-14 23:07:46